Założona w Londynie platforma do rozgrywek w Counter-Strike: Global Offensive to lider w kwestii liczebności graczy. W ostatnim czasie FACEIT nie był jednak pozbawiony wad. Do największych z pewnością można zaliczyć toksyczne community, które rujnuje rozgrywkę innym graczom. Zdaje się, że włodarze wreszcie zaradzili temu problemowi.

Osoba, która rozegrała chociaż kilka meczów na platformie doskonale wie, o czym mowa. Nie wspominając już o kilkugodzinnej sesji, gdzie często spotyka się trolling, griefing, wyzwiska na czacie głosowym/tekstowym oraz rasizm. Te problemy także wiążą się bezpośrednio z przejściem gry na tryb Free-To-Play, więc FACEIT podjął kroki, by zapobiec negatywnym skutkom aktualizacji. Zmiany tak naprawdę nastąpiły już u schyłku ubiegłego roku, gdy nieco zaostrzono politykę. Mowa tu o m. in. przymusie aktywacji anti-cheata przy braku Prime’a, szybszym egzekwowaniu banicji za oszukiwanie/smurfing, czy ulepszeniu systemu bazującego na zgłoszeniach graczy.

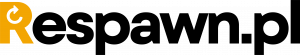

Początkowo społeczność domagała się obserwacji każdego meczu rozgrywanego na żywo przez administrację platformy. Stało się to jednak niewykonalne z uwagi na dużą liczbę meczów rozgrywanych w ciągu dnia. Wobec tego postawiono na coś innego, zaś ostatnich dniach nastąpiły ważne zmiany. Sztuczna inteligencja o nazwie Minerva ma za zadanie na bieżąco uczyć się wypowiedzi toksycznych użytkowników i podejmować natychmiastowe działania w celu ich neutralizacji. Według artykułu na blogu FACEIT, ilość toksycznych wiadomości zmniejszyła się o 20%. Dodatkowym rozwiązaniem jest zaimplementowanie weryfikacji SMS, by zapobiec tworzeniu kont przeznaczonych do smurfingu, boostingu, czy oszukiwania. FACEIT podzielił proces eliminacji toksycznych zachowań na trzy etapy:

- Identyfikacja rodzaju toksycznego zachowania w meczu

- Natychmiastowe podejmowanie działań w przypadku złamania regulaminu

- Przekazanie graczom informacji zwrotnej na temat tego, co zrobili źle, aby poprawić swoje zachowanie

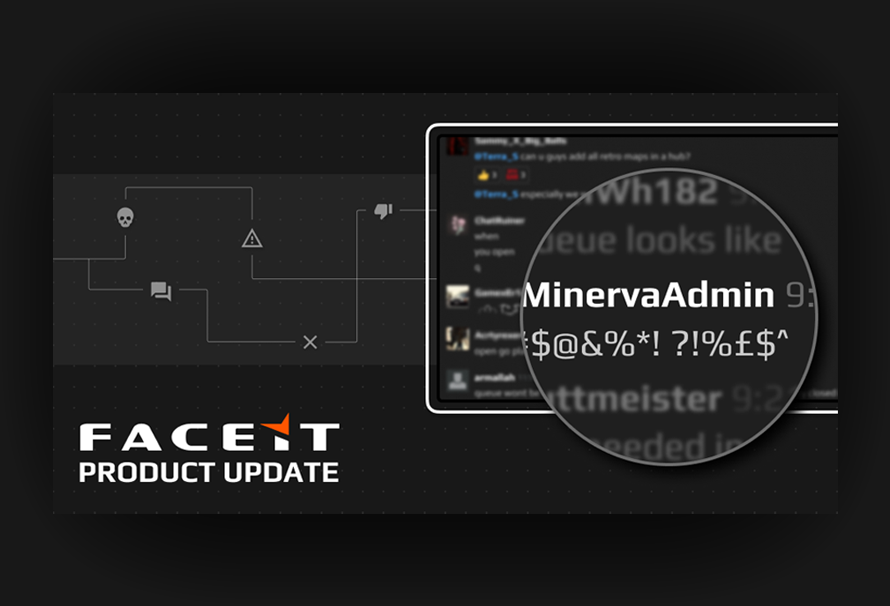

Za wprowadzeniem Minervy do platformy FACEIT stoi Jigsaw, firma walcząca z nadużyciami w świecie internetu, pochodząca od wszechobecnego Google‘a. Decyzja o tym, czy dany gracz zachowywał się nieodpowiednio następuje już w przeciągu kilku sekund po zakończeniu meczu. W momencie gdy nastąpiło naruszenie regulaminu, gracz otrzyma konkretne powiadomienie:

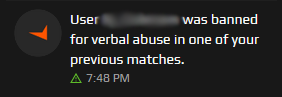

W momencie gdy zreportowany przez nas gracz otrzyma karę, także zostaniemy o tym powiadomieni w następujący sposób:

Minęło zaledwie kilka dni, a osobiście przyczyniłem się do ukarania kilku użytkowników, co widać powyżej. To udowadnia, że metoda naprawdę działa i warto aktywnie wspierać społeczność FACEIT poprzez zgłaszanie nieodpowiednich zachowań. To dopiero początek działań w celu poprawy doświadczeń z gry, lecz efekty z pewnością wykraczają poza oczekiwania. Włodarze platformy nie zamierzają poprzestać na aktualizacjach i zapowiedzieli wdrażanie kolejnych systemów, które zapewnią wsparcie sztucznej inteligencji.